Há muita negatividade e medo em torno da IA hoje. Não importa qual notícia seja divulgada – se for sobre o Google Gemini obtendo uma ‘memória’ ou o ChatGPT dizendo a um usuário algo que está obviamente errado, isso causará alvoroço em algumas partes da comunidade online.

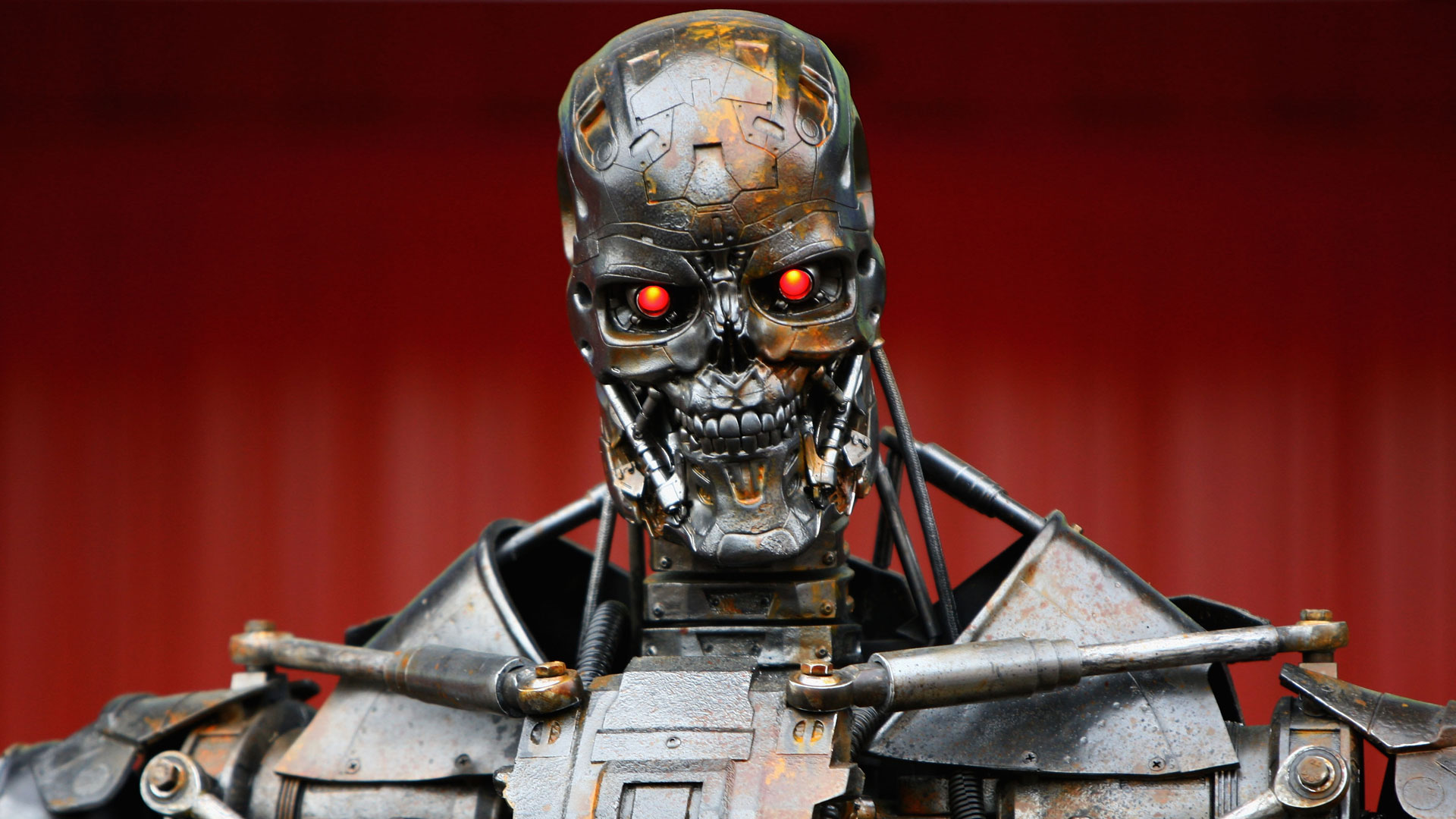

O foco atual na IA sobre a verdadeira inteligência artificial geral (AGI) criou um cenário de mídia quase histérico construído em torno da fantasia do Exterminador do Futuro e outros cenários apocalípticos.

Não é surpreendente, no entanto. Os humanos adoram um bom Armagedom – caramba, temos fantasiado bastante sobre isso nos últimos 300.000 anos. De Ragnarok ao Apocalipse, ao Fim dos Tempos, e todos os grandes sucessos de fantasia entre eles, estamos encantados. Nós simplesmente amamos as más notícias e a triste verdade delas, independentemente da causa genética.

A forma como o AGI é pintado hoje em dia, por quase todos os principais meios de comunicação vocal, vem da ideia de que a humanidade é a pior. Deve ver-se como uma força superior que é frustrada por seres humanos inferiores. Evolui até um ponto em que já não precisa do seu criador e desencadeia inevitavelmente alguma forma de evento de fim do mundo que varre todos nós da face da terra, seja através da aniquilação nuclear ou de uma pandemia. Ou pior, leva à condenação eterna (cortesia do Basilisco de Rocco).

Há uma crença dogmática neste tipo de visão por parte de alguns cientistas, especialistas da mídia, filósofos e grandes CEOs de tecnologia, todos os quais gritam do alto, assinam cartas e muito mais, instando aqueles que sabem disso a parar a IA. desenvolvimento

Todos eles ignoram o quadro geral, no entanto. Mesmo ignorando os enormes obstáculos tecnológicos necessários para simular algo próximo da mente humana (e muito menos uma superinteligência), todos eles não conseguem apreciar o poder do conhecimento e da aprendizagem.

Se uma IA tem a Internet na ponta dos dedos, a maior biblioteca de conhecimento humano que já existiu, e é capaz de compreender e compreender a filosofia, a arte e todo o pensamento humano até agora, por que isso tem que ser uma coisa ruim? ? Em vez de um ser equilibrado e atencioso, chamamos a nossa intenção de cair? Por que buscar a morte sem valorizar a vida? É um fenómeno estranho, como ter medo do escuro porque não conseguimos ver dentro dele. Estamos julgando e condenando algo que não existe. É uma parte confusa de tirar conclusões.

Gêmeos do Google finalmente ganha uma memória

No início deste ano, o Google introduziu muito mais capacidade de memória para seu assistente de IA, Gemini. Agora ele pode reter e consultar detalhes que você forneceu em conversas anteriores e muito mais. Nosso redator de notícias Eric Schwartz escreveu um ótimo artigo sobre isso, que você pode ler aqui, mas o resumo é que é um dos elementos-chave para afastar Gêmeos de uma definição restrita de inteligência e se aproximar da AGI. Emulação que realmente precisamos. Não terá consciência, mas apenas através de padrões e memória, poderá facilmente simular uma interação AGI com um humano.

Os avanços na memória profunda (grandes modelos de linguagem) no LLM são críticos para o seu desenvolvimento – o ChatGPT teve seus próprios avanços equivalentes no início do ciclo de desenvolvimento. No entanto, mesmo isto é limitado no seu âmbito global em comparação. Fale com o ChatGPT por tempo suficiente e ele esquecerá os comentários que você fez antes da conversa; Isso perderia o contexto. Ele quebra um pouco a quarta parede ao interagir com ela, torpedeando o famoso teste de Turing no processo.

Segundo Gêmeos, ainda hoje sua própria memória ainda está em desenvolvimento (e não é realmente revelada ao público). No entanto, acredita que são muito superiores ao ChatGPT, o que deverá aliviar alguns destes momentos de quebra de ilusão da quarta parede. Podemos estar em uma corrida de memória LLM AI agora, e isso não é uma coisa ruim.

Por que é tão positivo? OK, eu sei que é clichê para alguns – sei que usamos muito essa palavra, talvez de uma forma muito inesperada que a desvalorize como frase – mas estamos no meio de uma epidemia de solidão. Isto pode parecer ridículo, mas estudos mostram que, em média, o isolamento social e a solidão podem aumentar a mortalidade entre 1,08 e 1,48x (Andrew Steptoe e companhia 2013). É surpreendentemente elevado – de facto, vários estudos confirmaram agora que a solidão e o isolamento social aumentam o risco de doenças cardiovasculares, acidente vascular cerebral, depressão, demência, alcoolismo, ansiedade e podem até levar a uma maior probabilidade de desenvolver vários tipos de cancro. juntos

A sociedade moderna também contribuiu para isso. A unidade familiar, onde as gerações viveram pelo menos um pouco próximas umas das outras, está a desaparecer lentamente – especialmente nas zonas rurais. À medida que os empregos locais diminuem e os meios financeiros para uma vida confortável se tornam inatingíveis, muitos estão a afastar-se da segurança dos bairros onde cresceram, em busca de uma vida melhor noutro local. Combine isso com divórcio, separações e viuvez e inevitavelmente você terá maior solidão e isolamento social, especialmente entre os idosos.

É claro que existem cofatores, e estou fazendo algumas suposições por trás disso, mas não tenho dúvidas de que a solidão é um inferno para se lidar. A IA tem o potencial de aliviar parte dessa pressão. Pode proporcionar ajuda e conforto àqueles que se sentem socialmente isolados ou vulneráveis. É isso: a solidão e o isolamento social têm um efeito bola de neve. Quanto mais tempo você fica assim, mais ansiedade social você desenvolve e menor a probabilidade de você sair em público ou conhecer pessoas – e isso piora em um ciclo.

Os chatbots e LLMs de IA são projetados para interagir e conversar com você. Eles podem aliviar esses problemas e dar aos que sofrem de solidão a oportunidade de praticar a interação com as pessoas sem medo de rejeição. Ter uma memória capaz de reter os detalhes da conversa é a chave para que ela aconteça. Indo um passo adiante, a IA se tornou uma companheira genuína

Tanto o Google quanto o OpenAI reforçam ativamente os recursos de memória para Gemini e ChatGPT, de modo que, mesmo em suas formas atuais, essas IAs tenham a chance de evitar melhor os problemas dos testes de Turing e impedir a ocorrência desses momentos de quebra da quarta parede. Voltando ao Google por um momento, se o Gemini realmente for melhor que a capacidade limitada de memória do ChatGPT e funcionar como uma memória humana, então, neste ponto, eu diria que provavelmente estamos a ponto de chamá-lo de AGI. verdadeira imitação, pelo menos na superfície.

Se o Gemini algum dia se integrar totalmente a um alto-falante doméstico inteligente e o Google tiver o poder de processamento em nuvem para fazer backup de tudo (o que sugiro que esteja tentando impulsionar com os recentes avanços na energia nuclear), ele poderá se tornar um defensor social revolucionário para o bem na redução isolamento e solidão, especialmente entre os desfavorecidos.

Mas essa coisa – será necessária uma grande concessão computacional para fazer isso. Executar um LLM e manter todas essas informações e dados não é uma tarefa fácil. Ironicamente, executar o LLM exige muito mais potência computacional e armazenamento do que criar uma imagem ou vídeo de IA. Fazer isso para milhões ou potencialmente bilhões de pessoas exigiria poder de processamento e hardware que não temos atualmente.

ANIs terríveis

A realidade é que não é o AGI que me assusta. É a inteligência artificial estreita, ou ANI, que já está aqui, que é muito mais arrepiante. Estes são programas que não são tão sofisticados quanto possível AGI. Eles não têm ideia de nenhuma informação além daquela para a qual foram programados. Pense em um chefe do Elden Ring. Seu único objetivo é derrotar o jogador. Tem parâmetros e limitações, mas até que estes sejam cumpridos, a sua função é esmagar o jogador – nada mais, e não irá parar até que seja feito.

Se você remover essas restrições, o código ainda permanecerá e o propósito será o mesmo. Na Ucrânia, quando as forças russas começaram a usar dispositivos de interferência para impedir que os pilotos de drones voassem com sucesso contra os seus alvos, a Ucrânia começou a usar a ANI para destruir alvos militares, causando um aumento drástico nas taxas de acerto. Nos EUA, é claro que existem notícias falsas sobre simulações de IA da USAF (reais ou teóricas à parte), onde o drone matou o seu próprio operador para atingir o seu alvo. Você entendeu.

Esses aplicativos de IA são os mais assustadores e estão aqui agora. Eles não têm consciência moral ou processo de tomada de decisão. Você saca uma arma e diz para excluir um alvo, e ela fará exatamente isso. Para ser justo, os humanos são igualmente capazes, mas existem controlos e equilíbrios para conseguir isto, e uma bússola moral (espero) – mas ainda nos faltam leis concretas, quer a nível local quer a nível global, para resolver estas questões de IA. Claro, no campo de batalha.

Em última análise, tudo se resume a impedir que agentes mal-intencionados aproveitem as tecnologias emergentes. Há algum tempo, escrevi um artigo sobre a morte da Internet e como precisamos de uma organização sem fins lucrativos que possa responder rapidamente e legislar para os países contra ameaças tecnológicas emergentes no futuro. A IA precisa exatamente disso. Há organizações que estão a pressionar nesse sentido, a OCDE, por exemplo, é uma delas – mas as democracias modernas, e na verdade, os governos de qualquer tipo, são demasiado lentos para reagir a esta ameaça incomensuravelmente crescente. O potencial da AGI é incrível, mas ainda não chegamos lá e, infelizmente, a ANI chegou.